Une estimation précise du projet est un pilier fondamental du développement logiciel réussi. Lors de la planification d’un système, comprendre les mouvements de données sous-jacents fournit une base concrète pour prédire les besoins en ressources. Le diagramme de flux de données (DFD) sert d’outil visuel puissant pour cartographier ces mouvements. En analysant la complexité structurelle d’un DFD, les équipes peuvent obtenir des estimations d’effort plus fiables que si elles se fiaient uniquement aux exigences fonctionnelles.

Ce guide explore comment tirer parti des métriques de complexité des DFD pour affiner l’estimation de l’effort. Nous examinerons les composants qui entraînent la complexité, les méthodes pour quantifier ces éléments, ainsi que le processus de transformation de l’analyse diagrammatique en délais de projet.

🔍 Comprendre les diagrammes de flux de données dans la planification

Un diagramme de flux de données est une représentation graphique du flux de données à travers un système d’information. Contrairement aux diagrammes de flux qui se concentrent sur la logique de contrôle, les DFD se concentrent sur la transformation des données. Dans le contexte de l’estimation, un DFD agit comme un plan directeur du travail impliqué.

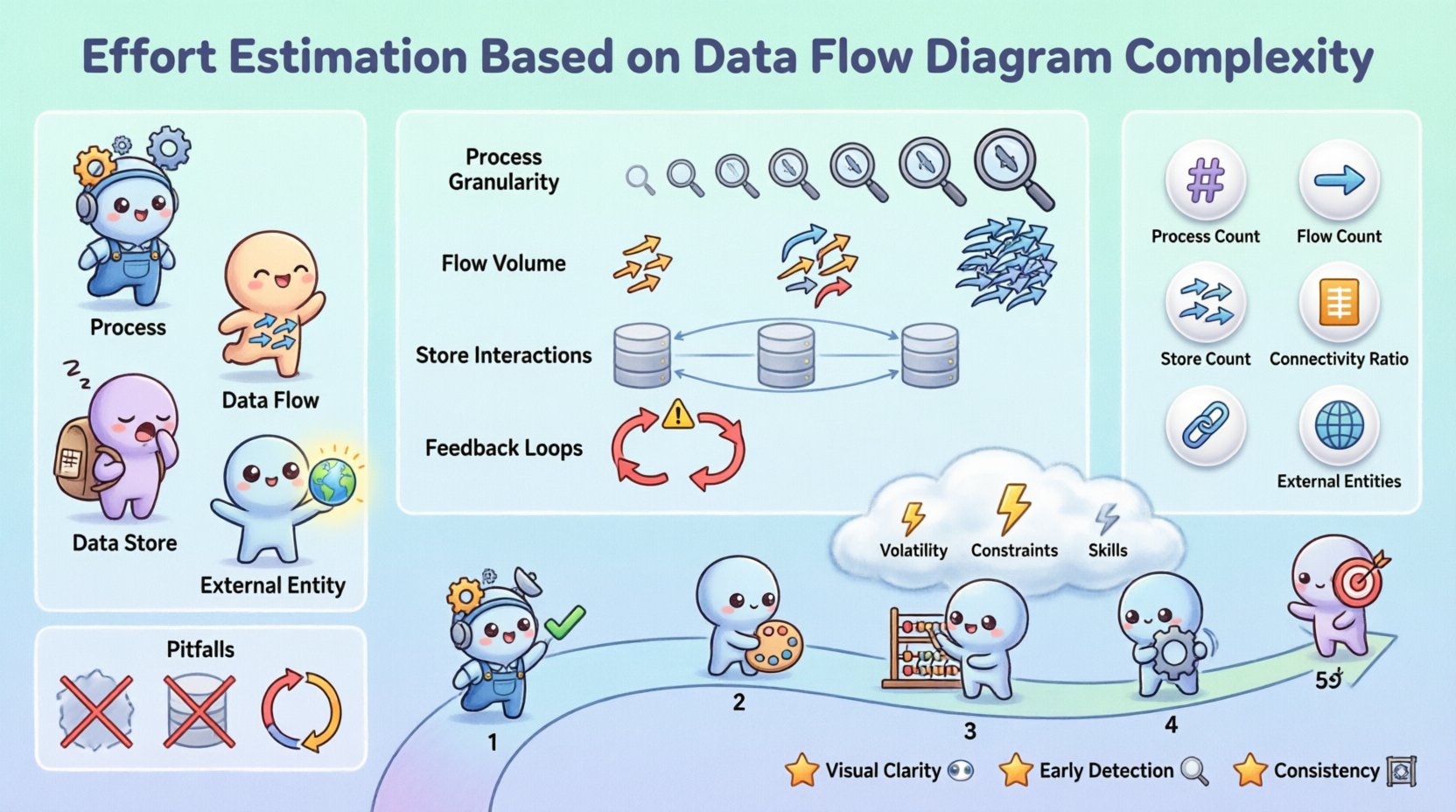

- Processus : Représentent les transformations des données. Chaque processus correspond généralement à une fonction ou un module spécifique dans le code.

- Flux de données : Montrent le déplacement des données entre les processus, les entrepôts et les entités. Ils représentent les interfaces et les points d’intégration.

- Entrepôts de données : Indiquent où les données sont stockées au repos. Ils correspondent aux tables de base de données ou aux systèmes de fichiers.

- Entités externes : Sources ou destinations de données en dehors du système. Elles définissent les exigences d’intégration.

Lors de l’estimation de l’effort, la densité visuelle et la connectivité de ces éléments fournissent des indices sur la charge cognitive nécessaire pour implémenter le système. Un diagramme éparse avec des flux linéaires suggère une complexité plus faible, tandis qu’un réseau dense d’interactions implique des défis d’intégration importants.

🏗️ Identifier les facteurs de complexité

Tous les flux de données ne sont pas équivalents. Certains représentent des transferts simples de champs, tandis que d’autres impliquent une logique métier complexe, une validation ou des protocoles de sécurité. Pour estimer avec précision, vous devez identifier les facteurs spécifiques qui augmentent la complexité au sein du diagramme.

1. Granularité des processus

Le niveau de détail dans un processus compte. Un processus de haut niveau comme « Traiter la commande » peut cacher des dizaines d’étapes intermédiaires. Si le DFD est de haut niveau, l’estimation doit tenir compte de la décomposition de ce processus. À l’inverse, un DFD détaillé de niveau 2 ou 3 révèle les unités de travail réelles.

- Processus à granularité grossière : Nécessitent plus de temps d’analyse pour être décomposés.

- Processus à granularité fine : Permettent une estimation plus directe, mais peuvent négliger les surcoûts liés à l’intégration.

2. Volume des flux de données

Le nombre de flèches reliant les éléments indique le volume de traitement des données. Chaque flèche représente une structure de données qui doit être validée, transformée, stockée ou transmise.

- Plus de flux signifient souvent plus de points d’API ou de requêtes de base de données.

- Les flux complexes peuvent nécessiter une gestion des erreurs et une logique de réessai.

3. Interactions avec les entrepôts de données

Chaque interaction avec un entrepôt de données introduit des considérations de latence, des problèmes de concurrence et une gestion du schéma. Un processus qui lit et écrit simultanément dans plusieurs entrepôts est plus complexe qu’un processus interagissant avec un seul entrepôt.

4. Boucles de rétroaction

Les boucles dans le diagramme indiquent un traitement itératif ou des changements d’état. Ce sont souvent les zones les plus sujettes aux erreurs dans le développement. Estimer pour les boucles exige de tenir compte des scénarios de test où l’état est maintenu sur plusieurs cycles.

📏 Métriques quantitatives pour l’estimation

Pour passer des observations qualitatives aux estimations quantitatives, des métriques spécifiques dérivées du DFD peuvent être appliquées. Ces métriques aident à standardiser le processus d’estimation sur différents projets.

| Métrique | Description | Impact sur l’effort |

|---|---|---|

| Nombre de processus | Nombre total de nœuds de transformation. | Corrélation directe avec les points fonctionnels. |

| Nombre de flux | Nombre total de flèches de déplacement de données. | Indique la complexité d’intégration et d’interface. |

| Nombre de stockages | Nombre total de répertoires de données. | Influence la conception de la base de données et l’effort de migration. |

| Ratio de connectivité | Ratio des flux sur les processus. | Des ratios élevés suggèrent des systèmes fortement couplés. |

| Nombre d’entités externes | Nombre de systèmes externes impliqués. | Augmente les risques de communication et de dépendance. |

En additionnant ces valeurs, vous pouvez créer un score de complexité. Par exemple, un système simple pourrait avoir 5 processus et 10 flux, tandis qu’un système complexe pourrait en avoir 50 et 150. Ce score peut ensuite être multiplié par un facteur de base d’effort déterminé à partir de données historiques.

🛠️ Le processus d’estimation

Traduire un DFD en une estimation d’effort nécessite une approche structurée. Suivez ces étapes pour garantir la cohérence et la précision de votre planification.

Étape 1 : Valider l’achèvement du diagramme

Avant d’estimer, assurez-vous que le DFD reflète fidèlement les exigences. La présence manquante de flux ou d’entités entraînera une sous-estimation. Vérifiez que chaque exigence de données a un flux correspondant et que chaque processus dispose d’une entrée et d’une sortie définies.

Étape 2 : Catégoriser la complexité des processus

Tous les processus n’ont pas besoin du même niveau d’effort. Attribuez un poids de complexité à chaque processus en fonction de sa logique.

- Simple :Mappage direct des données ou récupération. (Poids : 1)

- Moyen : Inclut la validation, le calcul ou le formatage. (Poids : 2)

- Complexe : Implique plusieurs magasins de données, des API externes ou des algorithmes complexes. (Poids : 3)

Étape 3 : Calculer l’effort de base

Multipliez le nombre de processus dans chaque catégorie par leurs poids respectifs. Additionnez ces valeurs pour obtenir le Score de Complexité de Base (SCB).

Formule : SCB = (Nombre simple × 1) + (Nombre moyen × 2) + (Nombre complexe × 3)

Étape 4 : Ajuster en fonction de la complexité du flux

Les volumes élevés de flux de données augmentent l’effort requis pour le développement des interfaces. Appliquez un multiplicateur de flux en fonction du nombre total de flux par rapport au nombre de processus.

- Faible ratio (≤ 2 flux par processus) : Multiplicateur 1,0

- Ratio moyen (3 à 5 flux par processus) : Multiplicateur 1,2

- Ratio élevé (> 5 flux par processus) : Multiplicateur 1,5

Étape 5 : Tenir compte des dépendances externes

Les entités externes introduisent des risques. Chaque système externe nécessite des tests d’intégration, une configuration de sécurité et une coordination éventuelle avec un fournisseur. Ajoutez une marge de temps fixe pour chaque entité externe.

⚠️ Ajuster en fonction du risque et de l’incertitude

Même avec un DFD détaillé, l’incertitude persiste. Des facteurs tels que des exigences qui évoluent ou une dette technique peuvent modifier l’effort requis. Ajustez vos estimations pour tenir compte de ces risques.

1. Volatilité des exigences

Si les exigences métier sont susceptibles de changer pendant le développement, le DFD pourrait nécessiter une révision importante. Dans de tels cas, ajoutez une marge de contingence de 15 à 20 % à l’effort total.

2. Contraintes techniques

Les systèmes hérités ou des exigences spécifiques d’infrastructure peuvent compliquer les flux de données. Si le DFD montre des données se déplaçant vers un mainframe hérité, l’effort pour gérer cette connexion peut être supérieur à celui des appels API standards.

3. Niveau de compétence de l’équipe

L’estimation suppose un niveau de compétence de base. Si l’équipe est nouvelle dans le domaine ou dans la pile technologique, la complexité des processus du DFD peut se traduire par un temps d’apprentissage plus élevé. Ajustez le temps par unité de processus en conséquence.

🚫 Pièges courants dans l’analyse du DFD

Éviter les erreurs courantes est crucial pour préserver l’intégrité de l’estimation. Plusieurs pièges peuvent entraîner des miscalculations importantes.

- Ignorer la validation des données :Un DFD montre les données en mouvement, mais pas les règles appliquées. La logique de validation représente souvent 20 à 30 % de l’effort du processus.

- Ne pas tenir compte de la gestion des erreurs : Les parcours normaux sont faciles à cartographier. Les parcours d’erreur, les réessais et la journalisation ajoutent une complexité cachée à chaque flux.

- En supposant une croissance linéaire :La complexité croît souvent de manière non linéaire. L’ajout d’un seul magasin de données peut faire croître de façon exponentielle la complexité des connexions en raison de la nécessité de maintenir la cohérence des transactions.

- Négliger la sécurité :Les couches de chiffrement, d’authentification et d’autorisation sont souvent implicites dans les schémas DFD. Prenez-les explicitement en compte dans l’estimation.

- Se concentrer uniquement sur les processus :Les magasins de données et les flux sont souvent plus longs à mettre en place et à tester que les processus eux-mêmes.

📅 Intégrer les estimations dans les calendriers du projet

Une fois l’effort calculé, il doit être associé à un calendrier. Cela implique l’allocation des ressources et la définition des jalons.

- Livraison par phases :Regroupez les processus selon leurs dépendances de flux de données. Livrez en premier les flux à haute priorité afin de réduire les risques.

- Flux de travail parallèles :Si les processus sont indépendants, ils peuvent être développés en parallèle. Utilisez le DFD pour identifier des groupes indépendants.

- Tests d’intégration :Programmez un temps dédié pour tester l’intégrité des flux de données. C’est souvent là que les DFD complexes échouent.

En alignant le calendrier sur les dépendances structurelles indiquées dans le schéma, vous créez un calendrier réaliste qui respecte le flux naturel du système.

🔄 Maintenir l’exactitude au fil du temps

Les estimations ne sont pas statiques. Au fur et à mesure que le projet progresse et que le DFD évolue, les estimations doivent être recalibrées.

- Mises à jour de la base :Lorsque le DFD est finalisé, mettez à jour les estimations initiales avec les scores de complexité réels.

- Analyse rétrospective :Après une phase, comparez le score de complexité estimé à l’effort réel dépensé. Cela affine les facteurs de pondération pour les projets futurs.

- Gestion des changements :Tout changement apporté au DFD doit déclencher une nouvelle estimation. Ne supposez pas qu’ajouter un petit flux a un impact négligeable.

🛡️ Considérations finales pour la planification basée sur les DFD

Utiliser les diagrammes de flux de données pour l’estimation des efforts fournit une méthode structurée et objective pour évaluer la taille du projet. Cela déplace la conversation loin des suppositions vers une analyse de l’architecture réelle des données du système.

Bien qu’aucun modèle ne soit parfait, l’approche de complexité des DFD offre des avantages significatifs :

- Clarté visuelle :Les parties prenantes peuvent voir le déplacement des données, ce qui rend la justification de l’effort transparente.

- Détection précoce : Les flux complexes peuvent être identifiés avant le début du codage, permettant des ajustements architecturaux.

- Conformité : Appliquer les mêmes métriques sur différents projets permet une meilleure gestion du portefeuille.

Souvenez-vous que l’objectif n’est pas la perfection, mais une planification éclairée. Revoyez régulièrement vos facteurs de complexité et mettez à jour vos bases. Au fur et à mesure que votre équipe acquiert de l’expérience avec des types spécifiques de flux et de processus, votre capacité à prévoir l’effort s’améliorera naturellement.

En traitant le diagramme de flux de données (DFD) comme un estimateur principal, vous alignez votre planification sur la nature fondamentale du système que vous construisez. Cela conduit à des budgets et des délais plus réalistes, et en fin de compte, à une livraison plus réussie des solutions logicielles.