Dans le paysage de l’ingénierie des systèmes et du développement logiciel, l’écart entre ce qui est demandé et ce qui est livré provient souvent d’une communication ambiguë. Les diagrammes de flux de données (DFD) agissent comme un pont visuel entre les exigences abstraites et la logique concrète de mise en œuvre. Valider les exigences du système à travers des revues structurées garantit que chaque mouvement, transformation et exigence de stockage de données est pris en compte avant le début du codage. Ce processus réduit les reprises et aligne l’exécution technique avec l’intention métier.

Ce guide explore la méthodologie de l’utilisation des revues de DFD pour valider les exigences. Il couvre les éléments fondamentaux de la modélisation des données, les étapes procédurales pour mener une session de validation, ainsi que les indicateurs utilisés pour déterminer le succès. En se concentrant sur le flux d’information plutôt que sur les simples fonctionnalités, les équipes peuvent identifier des lacunes logiques que les exigences traditionnelles basées sur le texte négligent souvent.

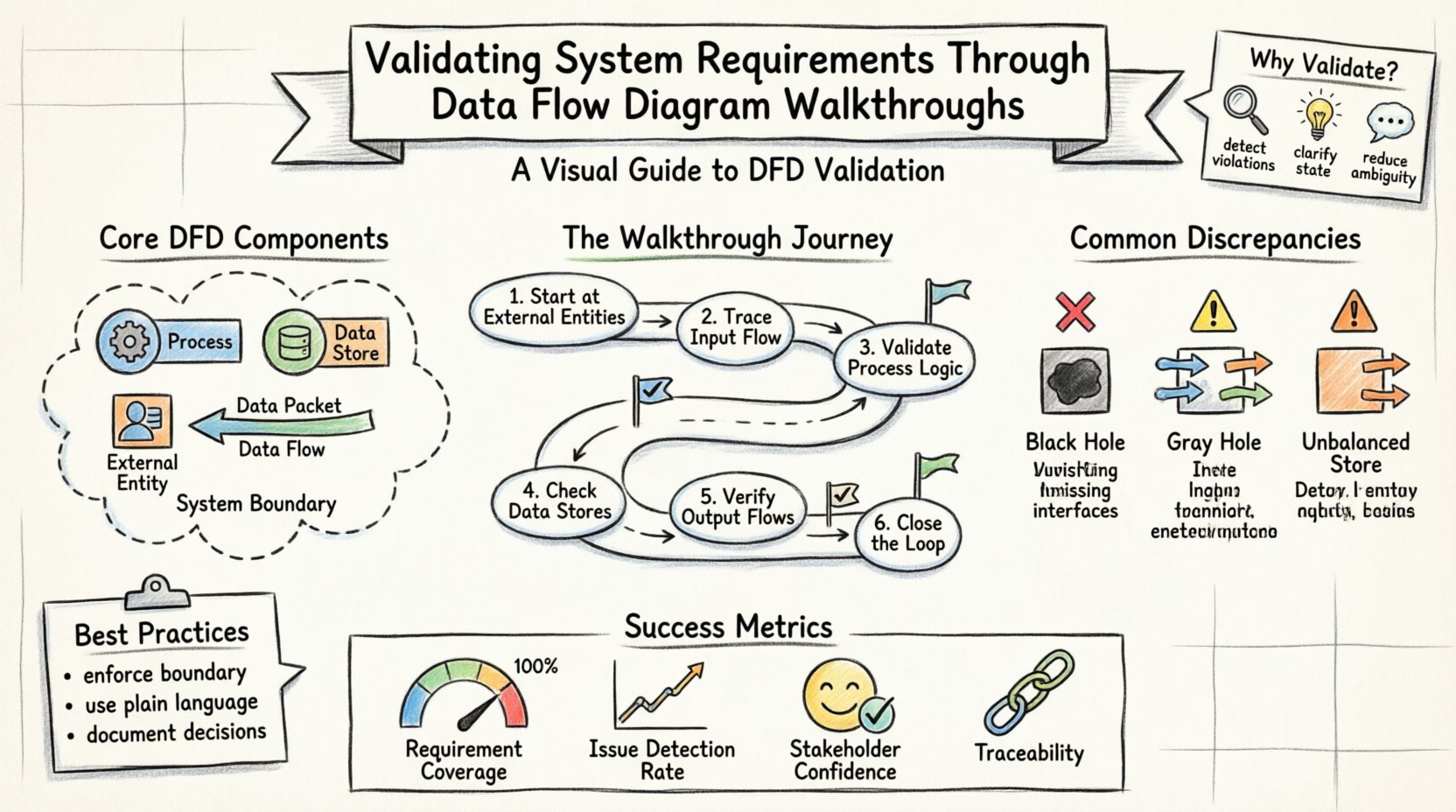

🧩 Comprendre les composants fondamentaux des DFD

Avant de commencer une revue de validation, il est essentiel de comprendre la notation et le sens utilisés dans les diagrammes de flux de données. Un DFD n’est ni un organigramme de logique de contrôle ni un schéma de base de données ; il représente le déplacement des données à travers un système. Une clarté sur cette définition évite toute confusion pendant la phase de validation.

Les éléments suivants constituent le fondement de tout DFD utilisé pour la validation des exigences :

- Traitements : Représentés par des rectangles arrondis ou des cercles, ce sont des activités qui transforment les données d’entrée en données de sortie. Chaque traitement doit avoir au moins une entrée et une sortie. Dans un contexte de validation, chaque traitement correspond à une règle métier ou un calcul spécifique défini dans les exigences.

- Stockages de données : Représentés par des rectangles ouverts, ils indiquent où les données sont stockées pour un accès ultérieur. Ils correspondent aux tables de base de données, aux fichiers ou aux caches. La validation de ces éléments garantit que les exigences de persistance sont respectées.

- Entités externes : Représentés par des carrés ou des icônes, ce sont des sources ou des destinations de données situées en dehors de la frontière du système. Des exemples incluent les utilisateurs, les API externes ou les organismes régulateurs. La validation de ces éléments garantit des définitions d’interfaces correctes.

- Flux de données : Représentés par des flèches, ils montrent le déplacement des données entre les entités, les traitements et les stockages. Chaque flèche doit être étiquetée avec les données spécifiques transmises. C’est la zone la plus critique à valider.

- Frontière du système : Une ligne conceptuelle qui sépare le système du monde extérieur. Tout ce qui est à l’intérieur fait partie du système ; tout ce qui est à l’extérieur est une entité externe.

Lors de la revue d’un DFD, l’attention se porte sur l’intégrité de ces composants. Si un flux de données entre dans un traitement mais qu’aucune donnée n’en sort, le traitement est incomplet. Si un stockage de données est accédé sans flux défini, cela indique une exigence manquante. La revue vise à détecter ces problèmes structurels.

🛡️ Le rôle fondamental de la validation des exigences

La validation des exigences est le processus de confirmation que les exigences documentées reflètent fidèlement les besoins des parties prenantes et sont réalisables. Alors que les spécifications fonctionnelles décrivent ce que fait le système, les DFD décrivent le comportement des données. Combiner ces deux points de vue permet un contrôle global.

Pourquoi cette étape de validation est-elle indispensable ?

- Détection des violations de conservation des données : Le principe de conservation des données stipule que toutes les entrées d’un traitement doivent produire des sorties, et qu’aucune donnée ne peut être créée ou détruite arbitrairement. Une revue révèle où les données disparaissent ou apparaissent sans source, indiquant une erreur logique dans les exigences.

- Identification des interfaces manquantes :Les exigences textuelles pourraient mentionner « envoyer un rapport », mais un DFD oblige l’équipe à définir précisément le contenu transmis. Si le diagramme montre un flux vers un générateur de rapports, mais que les exigences manquent de détails sur le format du rapport, le manque est évident.

- Précision des changements d’état :Les DFD ne montrent pas l’état, mais ils l’impliquent à travers les stockages de données. La validation du diagramme garantit que les déclencheurs des changements d’état sont correctement identifiés dans les exigences.

- Réduction de l’ambiguïté :Les modèles visuels réduisent les variations d’interprétation. Lorsque les parties prenantes pointent une flèche spécifique sur un diagramme, il y a moins de place à une mauvaise interprétation qu’en lisant un paragraphe de texte.

Sauter cette étape conduit souvent au phénomène du « surdimensionnement », où les développeurs implémentent des fonctionnalités non nécessaires, ou pire, oublient d’implémenter des transformations critiques de données parce que la logique n’a jamais été modélisée.

📋 Préparer une revue réussie

Effectuer une revue en marche est une activité rigoureuse qui nécessite une préparation. Se lancer dans une session sans objectif clair entraîne souvent des digressions et des problèmes non résolus. La phase de préparation fixe les bases d’une démarche de validation fructueuse.

1. Rassembler les bonnes personnes

L’équipe de revue doit inclure :

- Analystes métiers :Pour expliquer les règles métiers et les exigences.

- Architectes système :Pour garantir la faisabilité technique des flux.

- Parties prenantes :Pour confirmer que le modèle correspond à leur modèle mental du système.

- Développeurs :Pour apporter des éléments de compréhension sur les contraintes d’implémentation.

2. Définir le périmètre

Ne tentez pas de valider l’ensemble du système d’un coup. Divisez le diagramme des flux de données (DFD) en niveaux logiques. Commencez par le diagramme de contexte (niveau 0), qui représente le système comme un seul processus interagissant avec des entités externes. Ensuite, passez au niveau 1, qui décompose le processus principal en sous-processus. Cette approche hiérarchique évite la surcharge cognitive.

3. Établir la référence

Assurez-vous que le document des exigences est versionné et approuvé. Le DFD doit être traçable jusqu’à des identifiants d’exigences spécifiques. Créez une matrice de traçabilité qui relie chaque flux de données à une déclaration d’exigence. Pendant la revue, si un flux ne peut pas être traçé, il est signalé comme orphelin.

4. Distribuer les documents à lire à l’avance

Envoyez les diagrammes et les documents d’exigences au moins 24 heures avant la session. Cela permet aux participants de consulter le contenu et de préparer leurs questions. Le temps passé en réunion doit être consacré à la discussion et à la résolution, pas à la lecture.

🚶 Effectuer la revue étape par étape

L’exécution de la revue suit un chemin structuré. Le facilitateur guide le groupe à travers le diagramme, en suivant chaque trajet depuis sa source jusqu’à sa destination. Ce processus est souvent appelé « suivre le flux ».

- Commencez par les entités externes :Identifiez la source des données. Posez la question : « D’où proviennent ces données ? » Vérifiez que la source est définie dans les exigences. Vérifiez le type de données et sa fréquence.

- Suivez le flux d’entrée :Suivez la flèche entrant dans le premier processus. Posez la question : « Que devient cette donnée ? » Est-elle stockée ? Est-elle transformée ? Passe-t-elle à un autre processus ?

- Validez la logique du processus :Pour chaque boîte de processus, examinez les règles de transformation. Assurez-vous que les données de sortie correspondent au résultat attendu des données d’entrée selon les règles métiers. Vérifiez la complétude : toutes les entrées nécessaires sont-elles présentes ?

- Vérifiez les magasins de données :Lorsqu’un flux entre dans un magasin de données, vérifiez la condition de stockage. Le système doit-il conserver ces données de façon permanente ? Existe-t-il une politique de rétention ? Un flux de récupération est-il défini pour une utilisation ultérieure ?

- Vérifiez les flux de sortie :Suivez les flèches sortant du système. Correspondent-elles aux exigences en matière de rapports, de notifications ou de réponses API ? Assurez-vous que les données sensibles ne circulent pas vers des entités externes non autorisées.

- Fermez la boucle : Assurez-vous que toutes les données générées au sein du système ont une destination définie. Les sorties orphelines indiquent un défaut de conception.

Pendant ce processus, utilisez un tableau blanc ou une surface numérique pour annoter le schéma. Marquez les zones d’incertitude avec une couleur spécifique. Ne cherchez pas à résoudre chaque problème immédiatement ; enregistrez-les dans un journal d’actions pour une résolution ultérieure.

🕵️♂️ Identification des écarts courants

L’expérience montre que certains types d’erreurs se reproduisent fréquemment dans les modèles système. Reconnaître ces schémas accélère le processus de validation. Le tableau ci-dessous décrit les problèmes courants rencontrés lors des revues de DFD et leurs causes typiques.

| Type d’écart | Description | Impact de la validation |

|---|---|---|

| Trou noir | Un processus possède des entrées mais aucune sortie. | Les données sont consommées sans résultat. Cela indique une logique manquante ou une exigence non satisfaite. |

| Trou gris | Un processus possède des entrées et des sorties, mais la sortie ne découle pas logiquement des entrées. | Cela implique une logique cachée non capturée dans les exigences. Risque élevé d’erreur d’implémentation. |

| Violation du processus enfant | Les diagrammes de niveau inférieur montrent des flux absents dans le diagramme parent. | Erreur de décomposition. Dépassement de portée ou exigences parentes manquantes. |

| Magasin de données déséquilibré | Les données entrent dans un magasin mais n’en sortent jamais, ou inversement, sans justification. | Cela suggère des données orphelines ou des exigences de récupération manquantes. |

| Boucle d’entité externe | Les données circulent de l’Entité A au Système puis à l’Entité B, qui les renvoie directement à l’Entité A. | Cela peut indiquer un contournement du système ou une mauvaise compréhension de la frontière. |

Traiter ces écarts pendant la revue empêche qu’ils ne deviennent des bogues dans le système de production. Chaque problème identifié doit être enregistré avec une évaluation de gravité et attribué à un responsable pour sa résolution.

📈 Mesure de l’efficacité de la validation

Comment savez-vous que la revue a été un succès ? Se fier à un sentiment subjectif est insuffisant. Utilisez des indicateurs quantitatifs et qualitatifs pour évaluer la qualité de la validation.

- Couverture des exigences :Calculez le pourcentage des exigences qui ont un élément visuel correspondant dans le DFD. Une cible de 100 % de couverture pour les flux critiques est la norme.

- Taux de détection des problèmes :Suivez le nombre de défauts trouvés lors de la revue par rapport à ceux découverts pendant les tests. Un taux élevé de détection lors de la validation des exigences indique un processus de revue solide.

- Complétude de la traçabilité : Mesurez le pourcentage des flux de données qui ont un lien direct avec un identifiant de exigence. Les flux sans lien sont des candidats à la suppression ou à une définition plus approfondie.

- Confiance des parties prenantes : Après la revue, effectuez un court sondage. Les parties prenantes estiment-elles que le modèle représente fidèlement leurs besoins ? Leur confiance est un indicateur précoce du succès du projet.

- Volume des demandes de modification : Suivez le nombre de demandes de modification générées après le début de la phase de conception. Un DFD bien validé devrait entraîner moins de modifications des exigences au milieu du projet.

🔄 Maintenir l’alignement au fil du temps

Un DFD n’est pas un artefact statique. Au fur et à mesure que le système évolue, les exigences changent, et le diagramme doit évoluer avec elles. Le processus de validation ne doit pas être une action ponctuelle, mais une activité récurrente.

Contrôle de version

Tout changement apporté au DFD doit être versionné. Si un nouveau flux de données est ajouté, le numéro de version doit augmenter, et le journal des modifications doit détailler la raison. Cela permet de conserver un historique des évolutions des exigences au fil du temps.

Intégration aux cycles Agile

Dans un développement itératif, les DFD peuvent être mis à jour au début de chaque sprint ou version. Utilisez la revue comme mécanisme de contrôle. Aucun code pour une nouvelle fonctionnalité ne doit commencer avant que la partie pertinente du DFD ait été validée par rapport au backlog du sprint.

Automatisation et outillage

Bien que les revues manuelles soient efficaces, l’utilisation d’outils de modélisation qui imposent des règles de syntaxe peut détecter les erreurs avant la revue humaine. Les outils peuvent vérifier automatiquement les trous noirs ou les processus déséquilibrés. Toutefois, le jugement humain reste essentiel pour valider la logique métier.

Formation et transfert de connaissances

Les nouveaux membres de l’équipe doivent être formés aux DFD existants. Cela garantit qu’ils comprennent le contexte des données avant d’écrire du code. Le diagramme sert de source de vérité pour l’architecture des données, en complément du code source.

🛠️ Meilleures pratiques pour les facilitateurs

Le succès de la revue dépend souvent du facilitateur. Un facilitateur compétent maintient le groupe concentré et s’assure que toutes les voix sont entendues. Voici des pratiques spécifiques à adopter :

- Respectez la frontière : Si la discussion dérive vers des détails d’implémentation technique (par exemple, « Devrions-nous utiliser SQL ou NoSQL ? »), reportez-la. Concentrez-vous sur le flux de données. Les détails d’implémentation peuvent être traités séparément.

- Encouragez le silence : Après avoir posé une question, attendez. Souvent, l’insight le plus critique survient après un moment de silence, lorsque quelqu’un réalise qu’il a manqué un détail.

- Utilisez un langage clair : Évitez le jargon lors de la description du diagramme. Utilisez des termes que les parties prenantes métier comprennent. Si un terme est nécessaire, définissez-le immédiatement.

- Documentez les décisions : Toute décision prise lors de la revue doit être enregistrée. Si une exigence est jugée inutile, documentez cette décision avec sa justification. Cela évite les disputes ultérieures.

- Gérez les conflits : Les désaccords sur la propriété des données ou la direction du flux sont fréquents. Concentrez-vous sur les données elles-mêmes, et non sur les départements. Posez la question : « Qu’est-ce que les données ? » plutôt que « Qui détient cela ? »

🔗 Intégration avec d’autres techniques de modélisation

Les DFD n’existent pas en vase clos. Ils fonctionnent le mieux lorsqu’ils sont intégrés à d’autres techniques de modélisation pour offrir une vue complète du système.

- Diagrammes entité-association (ERD) : Alors que les diagrammes de flux de données montrent le mouvement, les diagrammes entité-association montrent la structure. Vérifiez la correspondance entre les magasins de données du DFD et les tables du ERD afin de garantir la cohérence.

- Diagrammes de transition d’état : Les DFD ne montrent pas l’état. Utilisez les diagrammes d’état pour définir le cycle de vie des objets de données (par exemple, une commande passant de « En attente » à « Expédiée »). Combine ces vues pour obtenir une spécification complète.

- Diagrammes de cas d’utilisation : Les cas d’utilisation décrivent les interactions du point de vue de l’utilisateur. Associez les cas d’utilisation aux processus du DFD pour garantir que chaque action utilisateur déclenche une transformation des données.

Cette approche multi-vue réduit le risque de points aveugles. Par exemple, un cas d’utilisation peut spécifier une action utilisateur, le DFD montre le chemin des données, et le ERD confirme l’intégrité du stockage. Ensemble, ils forment un cadre de validation solide.

🏁 Conclusion

Valider les exigences du système à travers des revues de diagrammes de flux de données est une discipline rigoureuse mais nécessaire. Elle transforme le texte abstrait en logique visuelle, révélant des lacunes qui resteraient autrement cachées jusqu’aux phases coûteuses de test. En respectant les principes de conservation des données, en maintenant la traçabilité et en effectuant des revues structurées, les organisations peuvent considérablement améliorer la qualité de leurs systèmes.

L’effort investi dans ces revues porte ses fruits sous forme de réduction des reprises, de communications plus claires et d’une confiance accrue des parties prenantes. Ce n’est pas simplement un exercice de documentation ; c’est une activité fondamentale de garantie de qualité qui assure que le système en cours de construction résout réellement le problème pour lequel il a été conçu.