Dans l’architecture des systèmes d’information complexes, l’intégrité des données est la fondation sur laquelle repose la fiabilité. Lorsque les données circulent entre des processus, des entités externes et des emplacements de stockage, des incohérences peuvent apparaître silencieusement, entraînant des pannes critiques, des erreurs de rapport et une sécurité compromise. Les diagrammes de flux de données (DFD) servent de plan visuel pour comprendre comment l’information traverse un système. Toutefois, un diagramme n’est valable que par la cohérence qu’il impose. Ce guide explore le processus rigoureux de vérification de la cohérence des données par une analyse détaillée des DFD, en garantissant que chaque octet entrant, traité et sortant du système reste précis et fiable.

La cohérence des données n’est pas simplement une case à cocher technique ; c’est une nécessité structurelle. Elle consiste à garantir que les définitions des données, les transformations et les mécanismes de stockage s’alignent parfaitement à travers toutes les couches de la conception du système. Sans cette alignement, les processus peuvent fonctionner sur des informations obsolètes ou incorrectes. En analysant le flux des données, les architectes et les analystes peuvent identifier les incohérences avant qu’une seule ligne de code ne soit écrite. Ce processus exige une compréhension approfondie de la dynamique du système, des structures logiques et des relations entre les différents composants.

🛡️ Comprendre la cohérence des données dans la conception des systèmes

Avant de plonger dans les mécanismes de vérification, il est essentiel de définir ce que signifie la cohérence des données dans le contexte de la conception des systèmes. Ce n’est pas un état binaire de « correct » ou « incorrect ». En réalité, il s’agit d’un spectre d’alignement entre différentes représentations de la même information.

📊 Définition des piliers fondamentaux

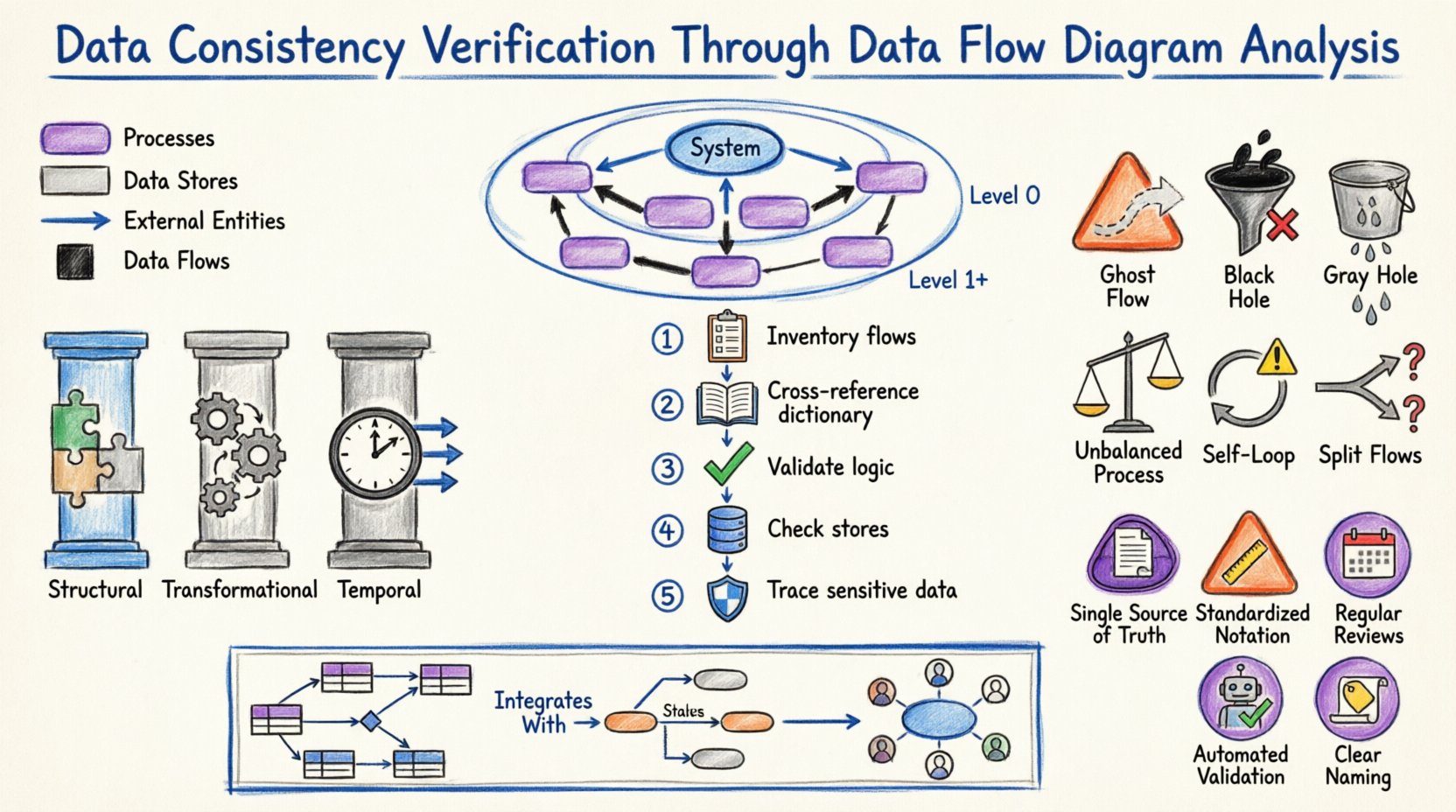

La cohérence dans la conception des systèmes relève généralement de trois catégories principales :

- Cohérence structurelle : Cela fait référence à l’alignement des structures de données. Si un processus attend un « ID client » sous forme d’entier, le magasin de données qui fournit cet ID ne doit pas retourner une chaîne.

- Cohérence transformationnelle : Cela garantit que la logique appliquée aux données pendant le traitement reste uniforme. Un calcul effectué dans le Processus A doit produire le même résultat qu’un calcul similaire dans le Processus B, sous réserve d’entrées identiques.

- Cohérence temporelle : Cela traite du moment des mises à jour des données. Les informations doivent être disponibles au moment où elles sont nécessaires, et les mises à jour doivent se propager à travers le système sans provoquer de conditions de course ou de lectures obsolètes.

Les DFD fournissent la carte pour naviguer entre ces piliers. En suivant les trajets des données, les analystes peuvent repérer les points où ces piliers pourraient céder. Par exemple, si un flux de données entre dans un processus sans flux de sortie correspondant, les données ont disparu, ce qui indique une erreur structurelle ou logique.

🔄 Le rôle du DFD dans la garantie de l’intégrité

Les diagrammes de flux de données sont bien plus que des dessins ; ils sont des spécifications formelles du mouvement de l’information. Dans le contexte de la vérification, un DFD agit comme un contrat entre les exigences et la mise en œuvre. Il précise d’où proviennent les données, où elles vont et comment elles évoluent.

🔎 Les composants clés et leur impact

Pour vérifier la cohérence, il faut comprendre le rôle spécifique que joue chaque composant :

- Entités externes : Ce sont les sources et destinations des données situées en dehors de la frontière du système. La vérification ici consiste à s’assurer que le système interprète correctement les entrées provenant des utilisateurs, d’autres systèmes ou des périphériques matériels.

- Processus : Ceux-ci transforment les données d’entrée en données de sortie. Les vérifications de cohérence ici portent sur la logique et les définitions du dictionnaire des données. Le processus modifie-t-il réellement les données comme décrit ?

- Magasins de données : Ce sont des répertoires où les données reposent. La cohérence implique de s’assurer que le schéma correspond aux flux entrant et sortant du magasin. Des données sont-elles écrites dans un magasin qui attend un format différent ?

- Flux de données : Ce sont les canaux qui transportent les données. Chaque flux doit avoir une source et une destination définies. Les flux non identifiés sont une source principale d’incohérence.

📉 Niveaux des DFD et vérifications de cohérence

Les DFD sont généralement hiérarchiques. Passer des abstractions de haut niveau aux détails spécifiques permet une vérification par couches. Chaque niveau nécessite un type différent de vérification de cohérence.

🏁 Niveau contextuel (Niveau 0)

Le diagramme de contexte représente l’ensemble du système comme un seul processus. Il montre les interactions avec les entités externes. La vérification à ce niveau se concentre sur le “frontière. Toutes les entités externes sont-elles prises en compte ? Tous les principaux flux d’entrée et de sortie de données traversent-ils la frontière ?

Liste de vérification au niveau du contexte :

- Y a-t-il exactement un processus qui représente le système ?

- Toutes les entités externes sont-elles correctement étiquetées ?

- Tous les flux de données traversant la frontière ont-ils des définitions claires ?

🏗️ Niveau 0 (décomposition de haut niveau)

À ce stade, le processus unique est décomposé en sous-processus majeurs. C’est ici quel’équilibre devient critique. Les entrées et sorties des sous-processus combinés doivent être égales aux entrées et sorties du processus parent du contexte.

Si le diagramme de contexte affiche une entrée de « Demande de commande », le diagramme du niveau 0 doit montrer « Demande de commande » en flux vers au moins un des processus de haut niveau. Si ces données disparaissent, il s’agit d’unetrou noir—une erreur critique de cohérence.

🧩 Niveau 1 et au-dessous (décomposition détaillée)

À mesure que les diagrammes sont décomposés davantage, l’attention se déplace versle flux logique. Les flux de données correspondent-ils au niveau de détail des processus ? Des données sont-elles transmises entre des processus qui devraient être stockées en premier ? Y a-t-il un couplage inutile entre les modules ?

📝 Protocole de vérification étape par étape

Vérifier la cohérence est une activité systématique. Elle exige une approche méthodique pour s’assurer qu’aucun détail n’est négligé. Le protocole suivant décrit la procédure standard d’analyse.

1️⃣ Inventaire de tous les flux

Commencez par énumérer tous les flux de données présents dans le diagramme. Créez une liste principale incluant le nom du flux, sa source et sa destination. Cet inventaire sert de base pour toutes les vérifications ultérieures.

2️⃣ Croisement avec les dictionnaires de données

Un dictionnaire de données définit la structure, le type et les contraintes de chaque élément de données. Chaque flux de données dans le DFD doit avoir une entrée correspondante dans le dictionnaire.

- Correspondance des noms : Assurez-vous que le nom du flux dans le diagramme correspond exactement au terme du dictionnaire.

- Correspondance des types : Vérifiez que le type de données (par exemple, Chaîne, Entier, Date) est cohérent entre le diagramme et le dictionnaire.

- Correspondance des contraintes : Vérifiez si les règles de validation (par exemple, « Doit être positif ») sont appliquées de manière cohérente.

3️⃣ Valider la logique des processus

Pour chaque nœud de processus, vérifiez la logique de transformation. Le processus produit-il tous les résultats attendus à partir des entrées ? Y a-t-il des sorties qui apparaissent sans cause logique ? Cette étape nécessite souvent la revue du pseudocode ou des règles métier associées au processus.

4️⃣ Vérifier l’alignement du magasin de données

Chaque flux de données entrant dans un magasin de données doit correspondre au schéma de ce magasin. Inversement, chaque flux sortant d’un magasin doit représenter des données qui existent réellement à l’intérieur. Vérifiez que les opérations de lecture et d’écriture sont équilibrées.

5️⃣ Suivre le parcours des données sensibles

Identifiez les flux contenant des informations sensibles (données personnelles, données financières). Assurez-vous que les vérifications de cohérence incluent les protocoles de sécurité. Si les données sont chiffrées à la source, sont-elles déchiffrées à la destination ? Y a-t-il des flux non chiffrés qui devraient être sécurisés ?

⚠️ Incohérences et modèles courants

Malgré une planification soigneuse, des incohérences apparaissent progressivement. Reconnaître les modèles courants d’erreurs permet une détection plus rapide lors de l’analyse. Le tableau ci-dessous décrit les problèmes fréquents et leurs conséquences.

| Nom du modèle | Description | Impact sur la cohérence |

|---|---|---|

| Flux fantôme | Un flux de données sans source ni destination. | Interrompt la continuité des données ; provoque des erreurs système. |

| Trou noir | Un processus ayant des entrées mais aucune sortie. | Les données sont perdues ; l’état du système devient indéfini. |

| Trou gris | Un processus où la sortie est inférieure à la somme des entrées, ou dont la logique ne tient pas compte de toutes les entrées. | Perte partielle des données ou agrégation incorrecte. |

| Processus déséquilibré | Un processus enfant possède des entrées/sorties différentes de celles du processus parent qu’il décompose. | Rompt la hiérarchie ; les exigences ne sont pas respectées. |

| Données en boucle sur elles-mêmes | Un flux de données qui revient sur le même processus sans passer par un magasin de données. | Indique des boucles infinies ou un manque de gestion d’état. |

| Flux divisés | Les données se divisent en plusieurs chemins sans nœud de décision. | Routage incertain ; risque de duplication de données. |

🔗 Intégration du dictionnaire des données

Le dictionnaire des données est la source unique de vérité pour les définitions des données. Sans dictionnaire, les schémas DFD sont ambigus. La vérification est incomplète sans croiser le diagramme avec ce référentiel.

📋 La condition de synchronisation

Lorsqu’un DFD est mis à jour, le dictionnaire des données doit être mis à jour simultanément. Un désaccord ici constitue une forme d’incohérence. Par exemple, si un champ est renommé dans le dictionnaire de « User_Name » à « Username », le DFD doit refléter immédiatement ce changement. Le fait de ne pas le faire crée un décalage entre le document de conception et la spécification d’implémentation.

📌 Cohérence des métadonnées

Au-delà des noms et des types, les métadonnées doivent être cohérentes. Cela inclut :

- Unités de mesure : La monnaie est-elle en USD ou en EUR ? Le poids est-il en kg ou en livres ? Cela doit être cohérent dans toutes les flux impliquant ces données.

- Normes d’encodage : Le texte est-il encodé en UTF-8 ou en ASCII ? Un encodage incohérent entraîne une corruption des données.

- Fuseaux horaires : Le système stocke-t-il le temps en UTC ou en heure locale ? Les flux impliquant des horodatages doivent s’accorder sur la norme.

🧭 Cohérence logique vs. cohérence physique

Une erreur courante consiste à confondre les conceptions logiques et physiques. Un DFD logique montrece que le système fait, tandis qu’un DFD physique montrecomment il le fait. La vérification de cohérence doit distinguer les deux.

🧱 Cohérence logique

Cela se concentre sur les règles métier et l’intégrité des données. Le flux a-t-il un sens du point de vue métier ? Par exemple, peut-on expédier une commande avant que le paiement ne soit autorisé ? La cohérence logique ignore la technologie et se concentre sur le flux de valeur.

💻 Cohérence physique

Cela se concentre sur les contraintes technologiques. Le flux de données correspond-il aux protocoles réseau ? Le format des données est-il compatible avec le moteur de base de données ? Une incohérence physique pourrait ne pas rompre la logique métier, mais entraînera une défaillance du système lors du déploiement.

🔄 Comblage de l’écart

Lors du passage du modèle logique au modèle physique, de nouveaux flux apparaissent souvent (par exemple, les journaux d’erreurs, les traces d’audit). Ces flux doivent être ajoutés au diagramme pour maintenir la cohérence. Si l’implémentation physique ajoute une étape que le diagramme logique n’avait pas prévue, le diagramme logique devient alors incohérent avec la réalité.

🔎 Référencement croisé avec les modèles de relations d’entités

Les DFD décrivent le mouvement, tandis que les diagrammes de relations d’entités (ERD) décrivent la structure. Pour garantir une cohérence totale, ces deux diagrammes doivent être alignés.

🗺️ L’exercice de cartographie

Pour chaque magasin de données dans le DFD, il doit y avoir un ensemble d’entités correspondant dans l’ERD. Pour chaque flux de données, il doit y avoir une relation ou un attribut qui justifie le mouvement.

- Vérification de cardinalité : Si un DFD montre un flux many-to-one vers un processus, l’ERD doit refléter la cardinalité correspondante de la relation.

- Cohérence des clés : Les clés primaires utilisées pour identifier les enregistrements dans l’ERD doivent être les mêmes clés utilisées dans les flux de données pour référencer ces enregistrements.

Les écarts ici entraînent souvent des goulets d’étranglement de performance ou des violations de l’intégrité référentielle pendant l’exécution. Une revue rigoureuse compare le schéma des magasins de données aux entités du diagramme entité-association.

🛠️ Maintenance et gestion du cycle de vie

La cohérence n’est pas un accomplissement ponctuel. C’est un état continu qui doit être maintenu tout au long du cycle de vie du système. À mesure que les exigences évoluent, les diagrammes doivent évoluer également.

📂 Contrôle de version pour les diagrammes

Tout comme le code nécessite un contrôle de version, les diagrammes de flux de données (DFD) en ont également besoin. Les modifications apportées à un diagramme doivent être suivies. Cela permet aux équipes de faire une revue pour savoir quand et pourquoi la cohérence a été compromise ou rétablie. Un journal des modifications doit accompagner chaque mise à jour du DFD.

🔄 Tests de régression

Lorsqu’un diagramme est mis à jour, les vérifications de cohérence doivent être réexécutées. Cela revient à des tests de régression en développement logiciel. Le nouveau flux a-t-il introduit un trou noir ? Le nouveau processus a-t-il rompu l’équilibre avec le contexte parent ? Les outils automatisés peuvent aider à cela, mais une revue manuelle est souvent nécessaire pour des logiques complexes.

👥 Alignement des parties prenantes

La cohérence implique aussi les personnes. Les parties prenantes métier doivent s’entendre sur les définitions des données. Si le métier définit un « utilisateur actif » comme quelqu’un qui s’est connecté la semaine dernière, mais que l’équipe technique le définit comme quelqu’un qui s’est connecté le mois dernier, le DFD reflétera la définition technique, entraînant des erreurs dans les rapports métiers. Des réunions d’alignement régulières sont essentielles.

📈 Traçabilité et journaux d’audit

Dans les secteurs réglementés, la traçabilité est une exigence légale. Chaque élément de données doit être traçable depuis sa source jusqu’à sa destination finale. Les DFD sont l’outil principal pour établir cette traçabilité.

🔖 Balisage des flux

Chaque flux de données doit être étiqueté avec des métadonnées indiquant son origine et son objectif. Cela facilite l’audit. En cas de violation de données, les analystes peuvent suivre le flux sur le diagramme pour identifier où la vulnérabilité aurait pu exister.

🔗 Analyse d’impact

Si une modification est proposée pour un magasin de données, le DFD permet une analyse d’impact. En suivant les flux connectés à ce magasin, l’équipe peut identifier tous les processus qui seront affectés. Cela évite les incohérences accidentelles causées par des modifications unilatérales.

🎯 Meilleures pratiques pour la maintenance

Pour maintenir la cohérence dans le temps, respectez ces meilleures pratiques :

- Source unique de vérité :Maintenez un référentiel principal pour les DFD. Ne permettez pas l’existence de plusieurs versions dans des emplacements différents.

- Notation standardisée :Utilisez une notation cohérente (par exemple, Gane & Sarson ou Yourdon & Coad) dans l’ensemble de la documentation. Le mélange de notations crée de la confusion.

- Revue régulière :Programmez des revues trimestrielles des DFDs par rapport à l’état actuel du système. Les systèmes évoluent avec le temps ; les diagrammes doivent suivre.

- Validation automatisée :Lorsque c’est possible, utilisez des outils de modélisation qui valident automatiquement les règles de cohérence (par exemple, empêcher les processus déséquilibrés).

- Conventions de nommage claires :Adoptez des conventions de nommage strictes pour les processus et les flux. Les noms ambigus sont une source d’incohérence.

🌐 Intégration avec d’autres méthodologies

Les DFD n’existent pas en vase clos. Ils font partie d’un écosystème plus large d’artefacts de conception.

📋 Diagrammes de transition d’état

Alors que les diagrammes de flux de données montrent le déplacement des données, les diagrammes de transition d’état montrent les changements d’état. Assurez-vous que les flux de données déclenchant un changement d’état correspondent aux conditions définies dans le diagramme d’état. Si un flux « Tentative de connexion » déclenche un changement d’état, la logique doit être cohérente dans les deux diagrammes.

📊 Diagrammes de cas d’utilisation

Les cas d’utilisation décrivent les interactions du point de vue de l’utilisateur. Les diagrammes de flux de données décrivent les mécanismes internes. Chaque cas d’utilisation doit correspondre à au moins un processus dans le diagramme de flux de données. Si un cas d’utilisation n’a pas de processus correspondant, la exigence n’est pas satisfaite. Si un processus n’a pas de cas d’utilisation, il pourrait s’agir de code mort.

🏁 Réflexions finales sur la vérification

Assurer la cohérence des données par l’analyse des diagrammes de flux de données est une discipline qui exige de la patience et une attention aux détails. Ce n’est pas simplement une question de trouver des bogues ; c’est construire une base solide. En vérifiant rigoureusement les équilibres, en croisant les dictionnaires et en maintenant l’alignement entre les vues logiques et physiques, les analystes système peuvent prévenir les erreurs avant qu’elles ne se manifestent en production.

L’effort investi dans cette vérification porte ses fruits en termes de stabilité du système et de réduction des coûts de maintenance. Un design cohérent est un design qui comprend ses propres données. À mesure que les systèmes deviennent plus complexes, la dépendance à des diagrammes clairs et cohérents devient la principale défense contre le chaos. Respecter ces principes garantit que le flux d’information reste aussi fiable que la logique métier qui le pilote.