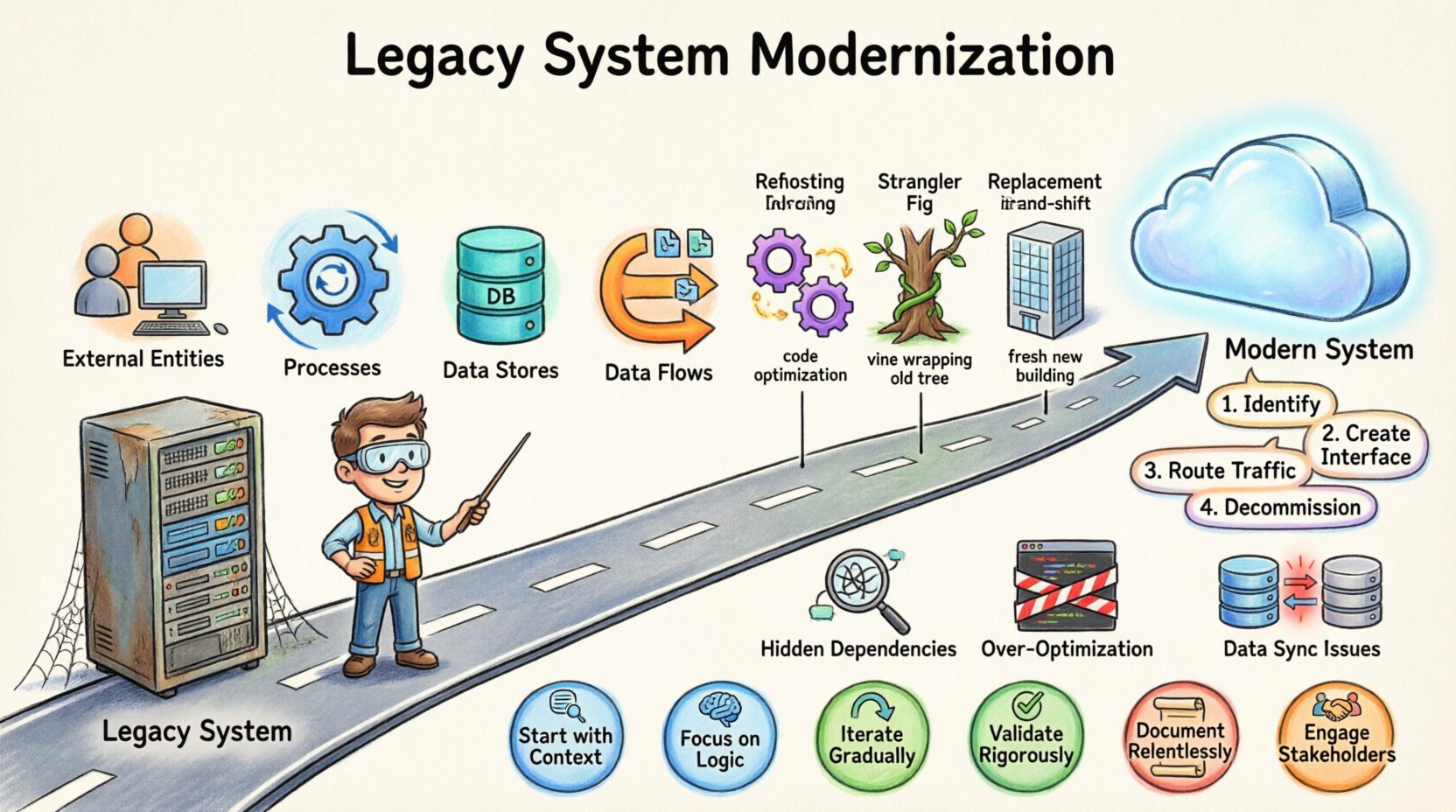

組織はしばしば、柔軟性やスケーラビリティを阻害する老朽化したインフラを維持している状況に陥る。ビジネス要件が進化する中で、基盤技術もそれに適応しなければならない。レガシーシステムの近代化は、陳腐化したコンポーネントを置き換える一方で、ビジネスロジックとデータ整合性を維持するという重要な取り組みである。この複雑な移行を円滑に進めるための最も効果的なツールの一つが、データフローダイアグラム(DFD)である。本ガイドでは、DFDを活用して近代化戦略を構造化し、分析し、正確かつ明確に実行する方法を解説する。

システムの近代化とは、単にコードを交換するだけではない。データが環境内でどのように移動し、変換され、保存されるかを理解することにある。これらの動きを可視化することで、チームは本番環境に問題が発生する前に非効率性や隠れた依存関係、リスクを特定できる。このアプローチにより、混沌とした再実装ではなく、計画的かつ体系的な移行が可能になる。

レガシーフレームワークにおけるデータフローダイアグラムの理解 📊

データフローダイアグラム(DFD)は、情報システム内を流れているデータの流れを図式化したものである。データがシステムに入力され、処理され、出力される様子をモデル化する。レガシーシステムの近代化という文脈において、DFDは「現状」の状態を理解し、「将来像」の計画を立てるための設計図として機能する。

クラスやデータベーステーブルに注目する構造図とは異なり、DFDは プロセス と 移動 に注目する。この違いは、近代化において極めて重要である。なぜなら、ビジネスロジックは構造そのものにではなく、データの流れの中に多く存在するからである。

DFDの核心的な構成要素

- 外部エンティティ:システム境界外のデータの発生源または到着地(例:ユーザー、他のシステム)。

- プロセス:入力データを出力データに変換する変換処理。

- データストア:将来の利用のために情報を保存する場所(データベース、ファイルなど)。

- データフロー:エンティティ、プロセス、ストアの間を移動するデータ。

レガシーシステム環境を分析する際、これらの構成要素は長年の技術的負債によって曖昧になりがちである。明確なDFDは実装の詳細を剥ぎ取り、ビジネス運用の論理的な流れを明らかにする。

移行前の分析:DFDを活用して 🧐

あらゆる近代化作業を開始する前に、現在のシステムに対する包括的な監査が必要である。この段階では、既存のデータフローを逆アーキテクチャして正確な基準を構築する必要がある。

ステップ1:コンテキスト図の作成

コンテキスト図は、システムを単一の高レベルなプロセスとして表現する。レガシーアプリケーションの境界と外部世界との相互作用を定義する。このステップでは、根本的な問いに答える。

- このシステムとやり取りしているのは誰か?

- どのようなデータがシステムに入力されるか?

- どのようなデータがシステムから出力されるか?

これらの境界を明確にすることで、近代化プロセス中に保持または置き換える必要がある外部依存関係を特定できる。たとえば、レガシーシステムが特定の政府APIと連携している場合、そのインターフェースは新しいエンドポイントにマッピングするか、ラッパーを介して維持する必要がある。

ステップ2:レベル0およびレベル1への分解

コンテキストが確立されると、単一のプロセスがサブプロセスに分解される。これにより、主要な機能領域を示すレベル0のDFDが作成される。さらに分解を進めることで、レベル1およびレベル2の図が得られる。

この詳細な視点により、アーキテクトは次のようなものを特定できる。

- 重複するプロセス:同じ計算を繰り返し行う複数のステップ。

- 孤立したデータストア:書き込まれるが一度も読み込まれないテーブルやファイル。

- 複雑なループ:非効率な論理を示唆するフィードバックループ。

これらの要素を早期に特定することで、不要な複雑性が新しい環境に移行されるのを防ぐことができる。

近代化パターンとDFDの整合性 🛠️

レガシーシステムを近代化するための標準的なアプローチはいくつかある。各パターンはDFDで定義されたデータフローと異なる形で相互作用する。適切なパターンを選択するには、フローの複雑さと望ましい結果を考慮する必要がある。

近代化戦略の比較

| 戦略 | DFDへの影響 | 最適な使用ケース | リスクレベル |

|---|---|---|---|

| リホスティング(リフト&シフト) | フローアーキテクチャへの最小限の変更。 | クラウドインフラへの迅速な移行。 | 低 |

| リファクタリング | 内部プロセスノードの最適化。 | 論理を変更せずにパフォーマンスを向上させる。 | 中 |

| ストレンジャーフィグ | 特定のフローの段階的置き換え。 | 即時置き換えが不可能な複雑なシステム。 | 中 |

| 置換 | フローの完全な再設計。 | 時代遅れの論理は、ビジネスニーズを満たさない。 | 高 |

ストレンジャーフィグパターンの実装

ストレンジャーフィグパターンは、レガシーシステムのコンポーネントを段階的に新しいサービスに置き換えることを含む。これはDFDを使用する場合特に効果的である。なぜなら、特定のデータフローを分離して移行できるからである。

- プロセスノードを特定する:レベル1のDFD内の特定の機能を選択する。

- 新しいインターフェースを作成する:この特定のフローを処理する新しいサービスを構築する。

- トラフィックをルーティングする:そのプロセスの受信データを新しいサービスにリダイレクトする。

- 旧ノードを廃止する:検証が完了したら、レガシープロセスを削除する。

この方法は、変更の範囲を常に限定することでリスクを低減する。各フローについてデータ整合性を検証した上で次のステップに進むことが可能になる。

データフローを新しいアーキテクチャにマッピングする 🗺️

近代化における最大の課題の一つは、新しいアーキテクチャに移行する際にデータが意味と関係性を保持していることを保証することである。リレーショナルデータベースはしばしばNoSQLに移行し、モノリシックなストレージはマイクロサービスに移行することが多い。

データストアの変換処理

レガシーデータフローダイアグラム(DFD)では、データストアが単一の大規模なテーブルを表すことがある。現代のマイクロサービスアーキテクチャでは、そのストアが複数のサービスに分割されることがある。DFDはこの変化を反映しなければならない。

- 正規化 vs. 非正規化:レガシーシステムは、スペースを節約するためにデータを正規化することが多い。現代のシステムでは、読み取り速度を向上させるために非正規化することがある。DFDは、結合が発生する場所を可視化し、回避可能かどうかを確認するのに役立つ。

- 整合性モデル:強整合性を要するフローと、最終整合性を許容できるフローを識別する。

- API契約設計:プロセスから出るすべてのデータフローは、APIリクエストまたはレスポンスとなる。DFDはペイロード構造を定義する。

データラインエージ追跡

移行中に、データがどこから来ているか、どこに到達するかを追跡することは不可欠である。包括的なDFDはラインエージマップとして機能する。新しいフローが導入された際には、そのデータの元へ遡って追跡し、データの損失や破損がないことを確認する必要がある。

たとえば、レガシーレポート生成プロセスが5つの異なるテーブルからデータを取得する場合、近代化されたバージョンは新しいAPI呼び出しが同じ情報を集約することを保証しなければならない。DFDは出力の論理的同等性を保証する。

一般的な落とし穴とリスク軽減 ⚠️

しっかりとしたDFDがあっても、近代化プロジェクトは大きな障害に直面する。一般的な落とし穴への認識が、チームがそれを成功裏に乗り越えるのを助ける。

落とし穴1:隠れた依存関係を無視する

レガシーシステムはしばしば文書化されていない相互作用を持つ。プロセスが主なDFDに表示されていないファイルを更新するバックグラウンドジョブを発動する可能性がある。

- 対策: コードのプロファイリングとログ記録を活用して、隠れたデータフローを発見する。これらの副作用を含めるためにDFDを更新する。

落とし穴2:過剰な最適化

チームは、移行中にDFD内のすべてのプロセスを最適化しようとすることがある。これにより範囲の拡大と遅延が生じる。

- 緩和策:高インパクトのフローに注力する。効率が悪いが安定しているプロセスは、リスクを伴わない限り変更しない。

落とし穴3:データ同期の問題

ストレンジャーフィグの実装中は、旧システムと新システムが共存する可能性がある。データの更新を同期させることで、乖離を防ぐ必要がある。

- 緩和策:二重書き込み戦略またはイベント駆動型の同期を導入する。DFDを更新して、同期経路を明確に示す。

検証とテスト戦略 🧪

近代化におけるテストはバグの発見にとどまらない。データフローがレガシーシステムと同一に動作することを検証することにある。

コントラクトテスト

データフローはプロセス間の契約を表しているため、コントラクトテストは不可欠である。自動テストは、各プロセスノードの入力と出力がDFDで定義された期待値と一致することを検証すべきである。

エンドツーエンドのフローテスト

外部エンティティからデータストアまで、図全体を実行してエンドツーエンドの経路が正常に動作することを確認する。これにより、サービス間の統合ポイントが正しいことを検証する。

- 入力検証: 外部エンティティが有効なデータを提供することを確認する。

- プロセス論理: 変換が正確であることを検証する。

- 出力の一貫性: 最終結果がレガシーシステムの出力と一致することを確認する。

移行中の技術的負債の管理 ⚖️

レガシーシステムは時間とともに技術的負債を蓄積する。近代化はこの負債を返済する機会であるが、戦略的に実施する必要がある。

DFDを用いた負債の特定

次のような点を確認する:

- スパゲッティフロー: 入出力の接続が多すぎるプロセス。

- 手動ステップ: 人的介入を要するプロセス(しばしば外部エンティティがプロセスとして表現される)。

- データの重複: 同じ情報を複数のストアが保持している。

これらの領域のリファクタリングにより保守性が向上する。ただし、一度にすべてを修正しようとしないでください。最も頻繁にエラーが発生するか、最も遅延が大きいフローを優先してください。

ドキュメントを納品物として扱う

このプロセス中に作成されたDFDは、重要なドキュメントとなる。将来のチームはソースコードを読まずにシステムを理解するためにそれらを利用できる。これは、将来の停滞リスクを低減する知識移転の形である。

- バージョン管理: DFDのバージョンをコードリリースと同期させる。

- アクセシビリティ: 図面がすべてのステークホルダー、特に技術的でないビジネスオーナーにもアクセス可能であることを確認する。

- 注釈: 視覚的なフローからは明らかでないビジネスルールを説明する注記を追加する。

長期的な保守と進化 📝

モダナイゼーションは一度きりの出来事ではない。ビジネスが成長するにつれて、データフローも変化する。DFD手法はこの進化を支援する。

図の継続的統合

DFDの更新を開発ライフサイクルに統合する。新しい機能が追加された際には、新しいプロセスやデータストアを反映するためにDFDを更新すべきである。これによりドキュメントが常に最新の状態を保てる。

フローの健全性のモニタリング

DFDに表示されているメトリクスを追跡するモニタリングツールを導入する。特定のデータフローが遅延したり失敗したりした場合、アラートを発動できる。これにより、ビジネスに影響が出る前にチームが問題に対処できる。

DFDを動的な文書として扱うことで、組織はアーキテクチャが運用上の現実と一致していることを保証する。このシステム進化に対する厳格なアプローチにより、将来のレガシー蓄積の可能性が低減される。

ベストプラクティスの要約 🏆

データフローダイアグラムを活用した成功裏のモダナイゼーションを実現するため、以下のガイドラインに従う。

- コンテキストから始める: 詳細に突入する前に、境界を定義する。

- 論理に注目する: 技術的な実装の詳細よりも、ビジネスロジックを優先する。

- 段階的に繰り返す: リスクを低減するために、ストレンジャーフィグパターンを使用する。

- 厳密に検証する: 完全なエンドツーエンドのテストにより、データフローの整合性を確保する。

- 断続的にドキュメント化する: 図を常に最新の状態に更新して、現在の状態を反映させる。

- ステークホルダーを関与させる: ビジネスオーナーが依存しているフローを理解していることを確認する。

モダナイゼーションは正確さを要する複雑な取り組みである。データフローダイアグラムを基盤となるツールとして活用することで、チームはレガシーシステムから現代システムへの移行を自信を持って進めることができる。これらの図表が提供する明確さにより、曖昧さが軽減され、技術的目標とビジネス目標が一致し、変革の過程を通じてデータが信頼できる資産のままであることが保証される。