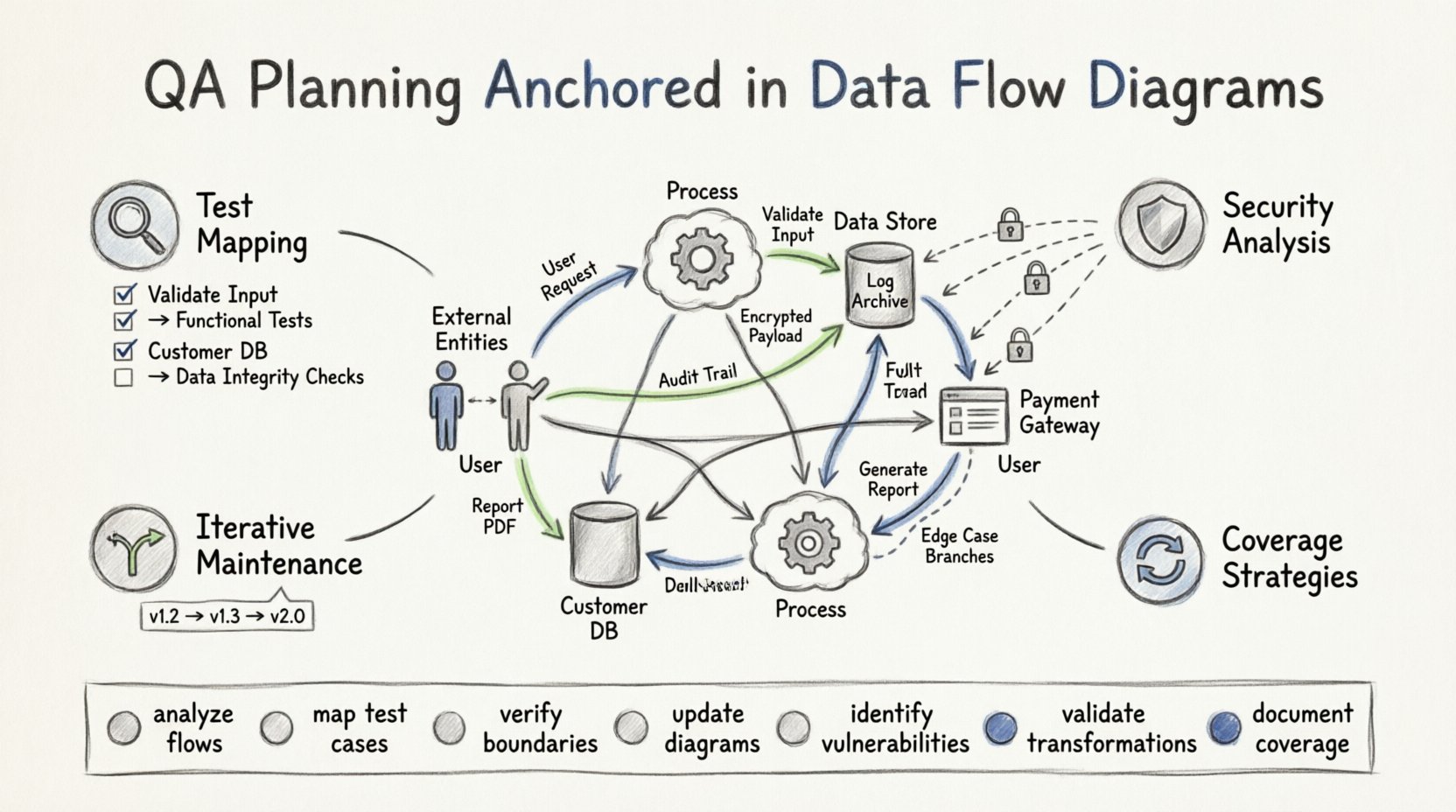

Une assurance qualité efficace repose sur la compréhension du déplacement des informations à travers un système. Sans carte claire, le test devient un jeu de devinettes. Les diagrammes de flux de données (DFD) fournissent le plan nécessaire pour ce parcours. Ils illustrent le flux des données entre les processus, les entrepôts de données, les entités externes et les flux de données. En ancrant votre planification QA dans ces diagrammes, vous vous assurez que chaque élément d’information est pris en compte, validé et sécurisé. Cette approche fait passer le test d’un débogage réactif à une assurance proactive. 🛡️

Ce guide explore comment tirer parti des DFD pour structurer votre stratégie de test. Nous allons aller au-delà des simples vérifications de fonctionnalité pour examiner l’intégrité des données, la précision de la transformation et la fiabilité du stockage. En considérant le DFD comme la source de vérité pour vos cas de test, vous créez un cadre solide qui détecte les problèmes tôt. Examinons maintenant les mécanismes de cette intégration.

Fondations : Pourquoi les DFD sont importants dans l’assurance qualité 🧩

L’assurance qualité est souvent perçue comme une phase qui a lieu après le développement. Cependant, la véritable qualité commence par la compréhension de l’architecture du système. Un diagramme de flux de données n’est pas seulement un élément de conception ; c’est un modèle logique du comportement du système. Il élimine les détails d’implémentation physique pour se concentrer sur le déplacement des données. Cette abstraction est cruciale pour les testeurs.

Lors de la planification des activités QA, il est essentiel de savoir où les données entrent, comment elles évoluent et où elles sortent. Les DFD répondent à ces questions de manière visuelle. Ils mettent en évidence les frontières du système et les dépendances entre les composants internes. Voici les raisons fondamentales de privilégier les DFD dans votre planification :

- Visibilité sur les chemins cachés : Les DFD révèlent les flux de données indirects qui pourraient être manqués lors de revues de code.

- Validation des processus : Ils définissent la transformation attendue des entrées en sorties.

- Définition des frontières : Ils marquent clairement où le système s’arrête et où commencent les entités externes.

- Intégrité des entrepôts de données : Ils identifient où les données persistent, nécessitant des tests spécifiques de stockage.

- Traçabilité des erreurs : Si les données sont corrompues, le diagramme aide à retracer l’origine de la défaillance.

Sans cet ancrage visuel, les cas de test reposent souvent sur des exigences superficielles. Cela entraîne des lacunes dans la couverture, où des anomalies de données passent inaperçues. Ancrez votre plan dans les DFD pour garantir une couverture complète fondée sur le flux logique plutôt que sur la simple liste des fonctionnalités. 🎯

Décortiquer le DFD pour le test 🧐

Pour planifier efficacement, vous devez comprendre les composants spécifiques d’un diagramme de flux de données. Chaque élément représente une cible de test. Examinons ensemble les quatre composants principaux et leurs implications pour l’assurance qualité.

1. Entités externes (sources et destinations) 🏢

Les entités externes représentent les utilisateurs, d’autres systèmes ou des organisations qui interagissent avec le logiciel. Dans la planification QA, ce sont vos entrées et sorties.

- Validation des entrées : Chaque flux entrant dans une entité nécessite des vérifications de validation. Que se passe-t-il si le type de données est incorrect ?

- Vérifications des autorisations : L’entité a-t-elle le droit d’accéder à ce flux de données spécifique ?

- Contrats API : Si l’entité est un autre système, le flux de données représente un contrat d’interface.

2. Processus (transformations) ⚙️

Les processus sont les lieux où les données changent. Ils prennent des entrées, appliquent une logique et produisent des sorties. C’est la logique centrale de l’application.

- Vérification de la logique : Assurez-vous que la transformation correspond aux règles métier.

- Conditions aux limites : Testez les limites du processus. Que se passe-t-il avec des données vides ? Que se passe-t-il avec de grandes quantités de données ?

- Vérifications des dépendances : Le processus A dépend-il de la sortie du processus B ?

3. Magasins de données (persistance) 🗄️

Les magasins de données représentent des bases de données, des fichiers ou des files d’attente où les informations sont sauvegardées. L’assurance qualité ici se concentre sur la cohérence et la sécurité.

- Accès en lecture/écriture :Vérifiez que seuls les processus autorisés peuvent modifier le magasin.

- Consistance des données :Assurez-vous que les mises à jour n’endommagent pas les enregistrements existants.

- Récupération :Si le magasin échoue, le système peut-il récupérer l’état des données ?

4. Flux de données (déplacement) 🔄

Les flux de données sont les flèches reliant les composants. Ils représentent la transmission réelle des informations.

- Conformité au format :Les données conservent-elles leur structure pendant le transit ?

- Sécurité :Les données sensibles sont-elles chiffrées pendant leur transmission ?

- Latence :Le flux répond-il aux exigences de performance ?

Mappage des éléments DFD aux cas de test 📝

Une fois que vous avez compris les composants, la prochaine étape consiste à les mapper à des activités QA spécifiques. Cela garantit qu’aucune partie du diagramme n’est laissée sans test. Le tableau suivant décrit la relation entre les éléments DFD et les actions de test requises.

| Élément DFD | Domaine d’attention de la QA | Questions clés de test |

|---|---|---|

| Entité externe | Interface et accès | L’utilisateur peut-il s’authentifier ? L’entrée est-elle nettoyée ? |

| Processus | Logique et transformation | Le calcul correspond-il à la formule ? La sortie est-elle correcte ? |

| Stockage de données | Intégrité et stockage | Les données sont-elles correctement enregistrées ? Sont-elles récupérables ? |

| Flux de données | Transmission et sécurité | Les données sont-elles chiffrées ? Le format est-il valide pendant le transfert ? |

| Processus décomposé | Validation du sous-processus | Les sous-processus contribuent-ils correctement à l’objectif principal ? |

En utilisant cette matrice, vous pouvez générer une liste de contrôle pour votre suite de tests. Si une ligne du tableau n’est pas cochée, vous avez une lacune dans votre couverture. Cette méthode prévient le problème courant où les testeurs se concentrent uniquement sur le parcours normal. Elle vous oblige également à envisager le parcours négatif.

Stratégies pour la couverture du flux de données 🕸️

La couverture en qualité assurance ne consiste pas seulement à atteindre des lignes de code. Elle consiste à atteindre les chemins logiques définis dans votre diagramme de flux de données. Il existe des stratégies spécifiques pour vous assurer de couvrir de manière complète le déplacement des données.

1. Test de couverture des chemins

Suivez chaque chemin unique depuis une entité externe jusqu’à un stockage de données ou retour vers une autre entité. Cela implique la création de scénarios de test qui suivent les flèches du diagramme. Si un processus se divise en deux branches, vous devez tester les deux branches. Cela garantit que la logique conditionnelle est vérifiée.

- Point de départ :Identifiez le point d’entrée dans le diagramme de flux de données.

- Point de fin :Identifiez le point de sortie ou le dernier stockage de données.

- Branchement :Représentez les points de décision où le flux pourrait diverger.

2. Validation de la transformation des données

Les processus transforment les données. Vous devez vérifier que la logique de transformation reste correcte à travers tout le système. Cela est souvent négligé lors des tests de haut niveau.

- Correspondance entrée/sortie :Comparez les données d’entrée avec la sortie finale après traitement.

- États intermédiaires :Vérifiez les données aux points de stockage intermédiaires pour vous assurer qu’elles n’ont pas été modifiées incorrectement.

- Conversion de format :Vérifiez que les types de données sont convertis correctement (par exemple, chaîne en entier, format de date).

3. Analyse de propagation des erreurs

Que se passe-t-il lorsque les données échouent à un point spécifique ? Un diagramme de flux de données aide à visualiser où des erreurs peuvent survenir et comment elles pourraient se propager. Vous devez prévoir des tests qui introduisent des défaillances à divers stades.

- Entrée non valide :Envoyez des données malformées à un processus. Échoue-t-il de manière correcte ?

- Données manquantes :Supprimez un champ obligatoire d’un flux de données. Le système alerte-t-il l’utilisateur ?

- Échec du stockage :Simulez une indisponibilité de la base de données. Le processus s’arrête-t-il ou réessaie-t-il ?

Identification des vulnérabilités par analyse des diagrammes de flux de données 🔍

La sécurité est un composant essentiel de l’assurance qualité. Les diagrammes de flux de données sont excellents pour repérer les faiblesses de sécurité avant même que le code ne soit écrit. En analysant le flux, vous pouvez identifier où les données pourraient être exposées.

1. Points d’accès non autorisés

Recherchez les flux de données qui traversent les frontières du système sans authentification claire. Si un processus lit dans un magasin de données sensible, assurez-vous que le flux indique un contrôle de sécurité.

- Montée de privilèges :Un utilisateur à faible niveau peut-il déclencher un processus à haut niveau ?

- Accès direct au magasin :Assurez-vous que les utilisateurs ne peuvent pas contourner les processus et accéder directement aux magasins de données.

2. Risques de fuite de données

Identifiez où circulent les informations sensibles (PII, données financières). Assurez-vous que ces flux sont marqués pour être chiffrés ou masqués.

- Journalisation :Le système journalise-t-il les flux de données sensibles ? Cela doit être interdit.

- Transfert à un tiers :Si les données quittent le système, sont-elles envoyées de manière sécurisée ?

3. Vecteurs d’attaque par déni de service

Certains flux de données pourraient être sensibles aux attaques par volume. Si un processus consomme de grandes quantités de données, cela pourrait constituer un vecteur d’épuisement des ressources.

- Tests de charge :Simulez des flux de données à fort volume sur les processus critiques.

- Gestion des files d’attente :Assurez-vous que les magasins de données peuvent gérer les pics de flux entrants.

Affinement itératif et maintenance 🔄

Le logiciel n’est pas statique. À mesure que les exigences évoluent, le système évolue également. Votre diagramme de flux de données doit évoluer en parallèle avec l’application. Les diagrammes statiques conduisent à des plans de test obsolètes. La planification de la QA ancrée dans les diagrammes de flux de données nécessite une stratégie de maintenance.

1. Contrôle de version pour les diagrammes

Traitez vos diagrammes DFD comme du code. Ils nécessitent un contrôle de version. Lorsqu’un processus change, le diagramme se met à jour, ainsi que le plan de test. Cela garantit une cohérence entre la conception et les tests.

- Journaux de modifications :Enregistrez chaque modification apportée au DFD.

- Analyse d’impact :Lorsqu’une modification est apportée, identifiez quels cas de test sont concernés.

- Cycles de revue :Programmez des revues régulières du DFD par rapport à la base de code actuelle.

2. Intégration aux cycles de développement

Les DFD doivent faire partie du flux de développement, et non seulement être une simple formalité de documentation. Ils aident les développeurs à comprendre les attentes en matière de test.

- Retours précoces :Les développeurs peuvent repérer des lacunes logiques dans le flux avant de coder.

- Compréhension partagée :Les équipes QA et Dev utilisent le même langage visuel.

- Synchronisation de la documentation :Les manuels utilisateurs et les documents techniques doivent faire référence au DFD actuel.

3. Gestion des systèmes complexes

Pour les systèmes complexes, un seul DFD est rarement suffisant. Vous aurez probablement besoin d’une hiérarchie de diagrammes (Contexte, Niveau 0, Niveau 1).

- Diagramme de contexte : Définit la frontière du système pour les tests de haut niveau.

- Diagramme de niveau 0 : Découpe les processus principaux pour les tests fonctionnels.

- Diagramme de niveau 1 : Détaille les sous-processus pour les tests unitaires et les tests d’intégration.

Utiliser cette hiérarchie vous permet d’échelonner votre planification QA. Vous n’avez pas besoin de tester chaque détail en une seule passe. Vous pouvez planifier d’abord les tests d’intégration de haut niveau, puis descendre vers des flux spécifiques.

Péchés courants dans la planification QA basée sur les DFD ⚠️

Même avec un plan solide, les équipes peuvent commettre des erreurs. Être conscient des erreurs courantes vous aide à les éviter.

- Surcomplexité :Un DFD avec trop de nœuds devient illisible. Gardez-le simple et centré sur les données, et non sur la logique de contrôle.

- Ignorer les flux de contrôle :Les diagrammes de flux de données se concentrent sur les données, mais les signaux de contrôle comptent. Assurez-vous que votre test tienne compte des changements d’état non affichés dans le flux.

- Mentalité statique :En supposant que le diagramme ne change jamais. L’adaptabilité est essentielle pour la QA moderne.

- Sauter les entités externes :Tester les processus internes est inutile si les entrées externes sont invalides. Testez toujours les limites.

- Supposer des données parfaites :Les données du monde réel sont désordonnées. Vos tests doivent refléter des flux de données sales, incomplets ou en double.

Construire un cadre de QA robuste 🏗️

Intégrer les diagrammes de flux de données dans votre processus de garantie de qualité crée un cadre résilient et évolutif. Il déplace la conversation de « cette fonctionnalité fonctionne-t-elle ? » à « les données circulent-elles correctement ? ». Cette distinction est vitale pour les systèmes complexes où l’intégrité des données est la proposition de valeur principale.

Commencez par auditer votre documentation actuelle. Si vous n’avez pas de diagrammes de flux de données, commencez à les créer. Impliquez vos parties prenantes. Les architectes, les développeurs et les testeurs doivent tous contribuer à l’exactitude du diagramme. Cette collaboration garantit que la carte est précise et que le plan de test est fiable.

Souvenez-vous que l’objectif n’est pas la perfection du diagramme, mais la clarté du plan. Un diagramme simple avec des limites claires est préférable à un diagramme complexe ambigu. Utilisez le diagramme de flux de données pour piloter la génération de vos cas de test, votre évaluation des risques et vos revues de sécurité. En ancrant vos efforts de QA dans le flux des données, vous assurez que le système fonctionne comme prévu dans toutes les conditions. 🚀

Résumé des actions clés 📋

- Analysez chaque flux de données pour vérifier la conformité du format et de la sécurité.

- Associez directement les cas de test aux processus et aux stocks du diagramme de flux de données.

- Vérifiez les conditions aux limites aux entités externes.

- Mettez à jour le diagramme chaque fois que l’architecture du système change.

- Utilisez le diagramme pour identifier les vulnérabilités de sécurité potentielles.

- Assurez-vous que toutes les transformations de données sont validées logiquement.

- Documentez la justification de la couverture des tests basée sur le flux.

Adopter cette approche structurée améliore la fiabilité de votre logiciel. Elle offre une vue claire du besoin à l’exécution. Lorsque votre assurance qualité repose sur la base du flux de données, vous construisez des systèmes qui ne sont pas seulement fonctionnels, mais aussi dignes de confiance. La confiance est la monnaie la plus précieuse dans le logiciel, et l’intégrité des données en est la preuve. 💡